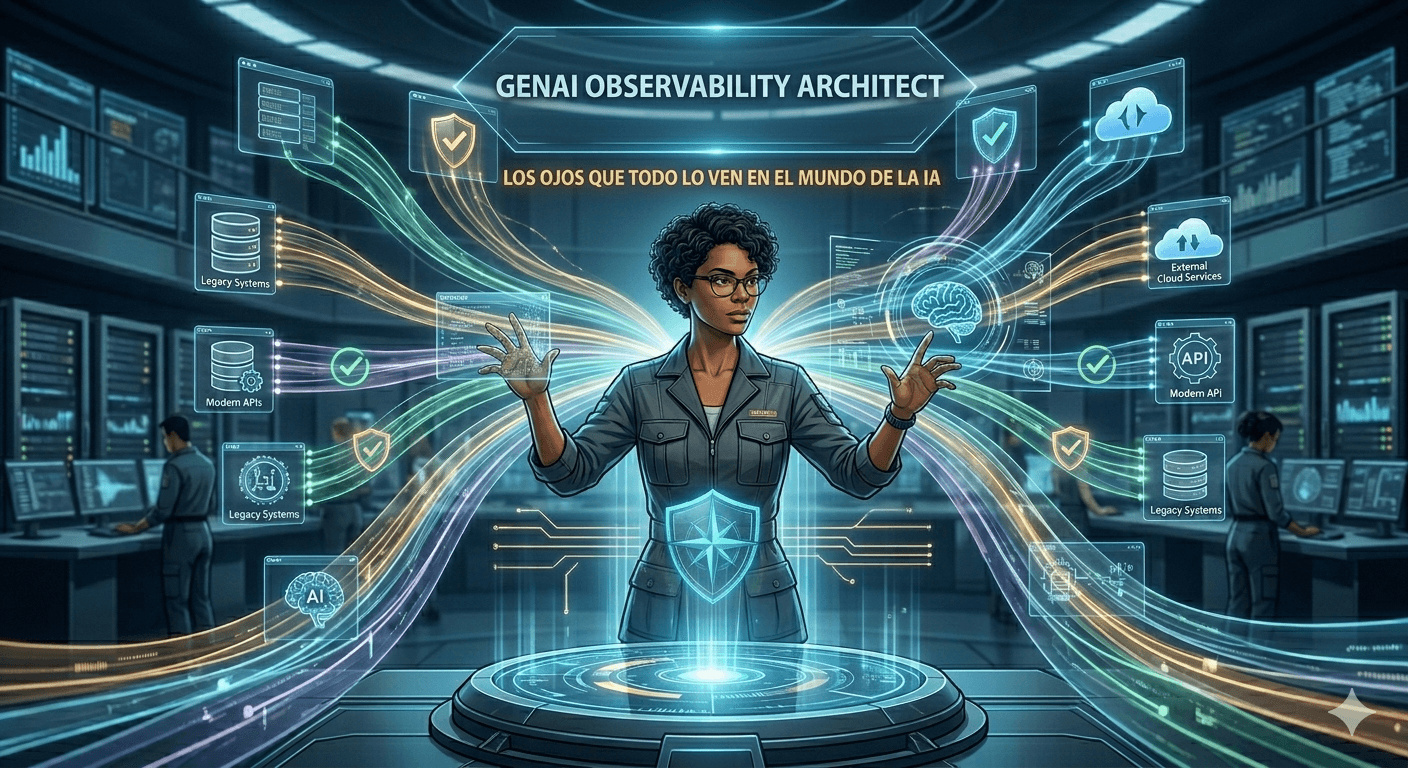

GenAI Observability Architect: Los Ojos que Todo lo Ven en el Mundo de la IA

Si construir sistemas de IA Generativa es complejo, entender qué están haciendo realmente es un desafío de nivel superior. Aquí entra el GenAI Observability Architect, el rol responsable de garantizar visibilidad y trazabilidad total del comportamiento de agentes GenAI, habilitando monitoreo, auditoría y detección temprana de riesgos.

El Problema: ¿Por Qué Observabilidad es Crítica en GenAI?

Los sistemas tradicionales son determinísticos: mismo input → mismo output. GenAI es probabilístico: mismo input → potencialmente diferentes outputs. Esto crea desafíos únicos:

La Caja Negra

No sabemos exactamente qué hará un LLM con un prompt dado. ¿Responderá correctamente? ¿Inventará información? ¿Filtrará datos sensibles?

Emergent Behaviors

Los agentes pueden exhibir comportamientos no anticipados cuando interactúan con usuarios reales o con herramientas.

Falta de Stack Traces

Cuando algo falla, no hay stack trace tradicional. ¿Por qué el agente decidió llamar esa función? ¿Por qué eligió ese documento del RAG?

Compliance & Auditoría

En sectores regulados (banca, salud), cada decisión asistida por IA debe ser auditable. "El modelo lo dijo" no es suficiente.

El Rol: Arquitecto de la Transparencia

Un GenAI Observability Architect diseña sistemas para:

Tracing: Seguir cada paso de una interacción con GenAI

Monitoring: Detectar anomalías, degradación, y problemas en tiempo real

Logging: Capturar toda la información relevante para debugging y auditoría

Analytics: Entender patrones de uso, calidad, y comportamiento a escala

Alerting: Notificar proactivamente cuando algo va mal

Competencias Técnicas Core

1. Distributed Tracing para GenAI

End-to-End Tracing:

Seguir request desde usuario hasta respuesta final

Capturar cada llamada a LLM, cada retrieval de RAG, cada tool call

Medir latencias en cada paso (network, model inference, DB queries)

Visualizar dependency graphs entre componentes

LLM-Specific Traces:

Prompt enviado al modelo (con variables resueltas)

Respuesta completa del modelo

Tokens consumidos (input + output)

Configuración: temperatura, top_p, max_tokens

Modelo utilizado y versión

Timestamp y latencia

Tool Calling Traces:

Qué herramientas decidió usar el agente

Argumentos pasados a cada herramienta

Respuestas recibidas

Decisiones basadas en esas respuestas

RAG Traces:

Query embeddings generados

Documentos retrieved (con scores)

Reranking decisions

Chunks finales usados en context

Agent Reasoning Traces:

Chain-of-thought steps

Decision paths en ReAct loops

Planning stages en agentes multi-step

2. Logging Estratégico

Structured Logging:

{

"timestamp": "2026-03-28T10:15:30Z",

"trace_id": "abc-123-def",

"span_id": "span-456",

"event": "llm_call",

"model": "gpt-4",

"prompt_template": "customer_support_v2",

"prompt": "Usuario pregunta: {query}",

"resolved_prompt": "...",

"response": "...",

"tokens": {

"input": 850,

"output": 320,

"total": 1170

},

"latency_ms": 2340,

"cost_usd": 0.047,

"metadata": {

"user_id": "user_789",

"session_id": "session_xyz",

"environment": "production"

}

}

Log Levels para GenAI:

TRACE: Cada paso interno (debugging profundo)

DEBUG: Prompts, responses, decisiones de agentes

INFO: Interacciones exitosas

WARN: Respuestas de baja calidad, latencias altas, near-limits

ERROR: Failures, timeouts, degraded responses

Sensitive Data Handling:

Redacción automática de PII en logs

Políticas de retención diferenciadas

Encriptación de logs en reposo

Access control granular a logs

3. Metrics & KPIs

Performance Metrics:

Latency: p50, p95, p99 (end-to-end y por componente)

Throughput: Requests per second

Error rate: % de requests fallidos

Timeout rate: % de requests que exceden SLA

Quality Metrics:

Relevance scores: Qué tan relevantes son las respuestas

Hallucination rate: % de respuestas con información inventada

Groundedness: % de respuestas basadas en sources

Completeness: ¿Responde la pregunta completamente?

User satisfaction: Thumbs up/down, CSAT scores

Cost Metrics:

Token consumption: Total, por usuario, por feature

Cost per query

Cost by model: GPT-4 vs GPT-3.5 vs Claude

Budget burn rate: ¿A qué ritmo gastamos?

Behavioral Metrics:

Tool usage frequency: Qué herramientas usa el agente

RAG hit rate: % de queries que utilizan RAG

Multi-turn conversations: Duración de sesiones

User intents: Categorización de lo que piden usuarios

Security Metrics:

Prompt injection attempts detectados

PII exposure incidents

Policy violations: Intentos de jailbreak, contenido prohibido

Access anomalies: Usuarios accediendo info fuera de su scope

4. Real-Time Monitoring & Dashboards

Dashboards Operacionales:

Sistema health: Status de componentes (LLM API, vector DB, cache)

Live traffic: qps, latencia en tiempo real

Error spikes: Alertas visuales de anomalías

Cost tracker: Gasto acumulado en el día/semana/mes

Dashboards de Calidad:

Quality scores trending over time

Hallucination incidents por categoría

User feedback aggregated

A/B test results: Comparación de variantes

Dashboards de Negocio:

Feature adoption: ¿Qué features de GenAI usan más?

User engagement: Retención, frecuencia de uso

Business impact: Conversiones, resolución de tickets, etc.

Agent-Specific Dashboards:

Decision trees de agentes multi-step

Tool call patterns

Success rate por tipo de tarea

5. Alerting & Anomaly Detection

Rule-Based Alerts:

Latency > threshold

Error rate > X%

Cost spike > $Y en Z minutos

Quality score drop > threshold

ML-Based Anomaly Detection:

Baseline learning de comportamiento normal

Detección de desviaciones estadísticas

Seasonal patterns (tráfico, tipos de queries)

Drift detection en distribuciones

Smart Alerting:

Alert fatigue prevention: Grouping, deduplication

Runbook automation: Alertas con pasos de mitigación

Escalation policies: By severity y time

Integration: PagerDuty, Slack, Teams

6. Auditability & Compliance

Audit Trails:

Cada decisión asistida por IA debe ser reconstituible

¿Qué datos vio el modelo? → RAG sources trackeadas

¿Qué decisión tomó? → Reasoning captured

¿Quién aprobó/overrode la decisión? → User actions logged

Compliance Features:

Data residency: Dónde se almacenan logs

Retention policies: GDPR-compliant

Immutable logs: Prevent tampering

Audit reports: Automated generation para reguladores

Explainability Support:

Capturar inputs, outputs, y reasoning

Visualization tools para auditors

Citation tracking: De respuesta → documento fuente

7. A/B Testing & Experimentation

Experiment Infrastructure:

Feature flags para rollouts controlados

Traffic splitting (% de usuarios por variante)

Metrics comparison automatizado

Statistical significance testing

What to Test:

Diferentes modelos (GPT-4 vs Claude vs Gemini)

Prompt templates

RAG strategies (top-k, reranking)

Agent architectures (ReAct vs Plan-and-Execute)

Experiment Analysis:

Automated reports con winners

Confidence intervals

Segment analysis (¿funciona mejor para cierto tipo de query?)

8. Debugging & Root Cause Analysis

Trace Replay:

Reproducir exact interaction para debugging

Rerun con diferentes configuraciones

Compare behavior entre versiones

Correlation Analysis:

¿Por qué falló este request?

Patrones comunes en errores

Impact analysis de cambios

Session Replay:

Ver toda la conversación multi-turno

Context evolution a lo largo de la conversación

Identificar dónde se "perdió" el agente

Stack Tecnológico

Distributed Tracing

LangSmith: Purpose-built para LLM apps (líder actual)

Weights & Biases: ML-first, strong visualization

Arize AI: ML observability + LLM support

Helicone: Lightweight LLM proxy para logging

OpenTelemetry: Standard abierto, integración amplia

APM & Monitoring

Datadog: APM tradicional + LLM observability emerging

New Relic: Similar, expanding to AI observability

Grafana + Prometheus: Open source, custom metrics

Elastic Stack: Logging + analytics

Log Management

Splunk: Enterprise-grade

ELK Stack: Open source

Datadog Logs

CloudWatch (AWS), Azure Monitor, GCP Logging

Experiment Platforms

LaunchDarkly: Feature flags + experimentation

Optimizely: A/B testing

Custom solutions: Statsig, GrowthBook

API Gateways & Proxies

Helicone: LLM-specific proxy con observability

Kong: API gateway con plugins

Custom proxies: Para control total

Arquitectura de Referencia

Casos de Uso en Banca

1. Auditoría de Decisiones de Crédito

Cuando un agente GenAI asiste en decisiones de préstamos, cada paso debe ser auditable.

Observability necesaria:

¿Qué información del cliente se consultó?

¿Qué políticas/regulaciones se consideraron?

¿Qué recomendación dio el agente?

¿El analista siguió o modificó la recomendación?

2. Detección de Fraude

Sistemas GenAI que identifican patrones de fraude necesitan monitoring extremo.

Observability necesaria:

False positive/negative rates

Drift en patrones de fraude

Latencia (tiempo es crítico)

Precision/recall por tipo de fraude

3. Customer Support

Chatbots y agentes de soporte deben mantener calidad consistente.

Observability necesaria:

CSAT scores por conversación

Resolution rate

Escalation rate (cuándo pasa a humano)

Topic clustering (qué preguntan más)

4. Compliance Screening

Agentes que revisan transacciones para compliance (AML, KYC).

Observability necesaria:

100% de decisiones loggeadas

Audit trail completo

Alert para decisiones borderline

Regular audits de accuracy

Métricas de Éxito del Observability Architect

MTTD (Mean Time to Detect): Qué tan rápido detectamos problemas

MTTR (Mean Time to Resolve): Qué tan rápido los solucionamos

Coverage: % de sistema instrumentado

Signal-to-noise ratio: Alertas que importan vs false positives

Audit compliance: 100% de requests auditables

Cost transparency: 100% de costos atribuibles

Desafíos Únicos

El Dilema de Logging vs Privacy

Necesitas loggear prompts/responses para debugging, pero pueden contener PII. Balance crítico.

Volumen de Datos

Los traces de GenAI generan MUCHO más data que software tradicional. Storage y querying a escala es desafío.

Evaluación de Calidad

¿Cómo mides automáticamente si una respuesta es "buena"? Requiere LLM-as-judge u otros mecanismos complejos.

Attribution

En un sistema multi-agente, ¿quién es responsable de una mala respuesta? El orchestrator, el specialist agent, el RAG retrieval?

El Futuro: Observability Predictiva

La próxima frontera:

Predictive Alerting: Detectar problemas antes de que ocurran

Auto-Remediation: Sistemas que se corrigen automáticamente

Continuous Evaluation: Evaluar calidad en cada request, no solo en batch

Cross-System Observability: Traces que abarcan múltiples agentes y sistemas

Conclusión

En un mundo donde GenAI toma decisiones que impactan clientes, costos y compliance, la observabilidad no es opcional, es fundamental. Un GenAI Observability Architect construye los sistemas que convierten la caja negra de los LLMs en un sistema transparente, auditable y confiable.

En banca, donde cada decisión puede tener implicaciones regulatorias, la observabilidad es la diferencia entre "tenemos agentes GenAI" y "tenemos agentes GenAI en producción, a escala, con confianza total".

La visibilidad es la base de la confianza. Y la confianza es la base de la adopción.

¿Cómo monitoreas tus sistemas GenAI? ¿Qué herramientas usas? Comparte tu experiencia.

#GenAI #Observability #Monitoring #AIGovernance #LangSmith #MLOps