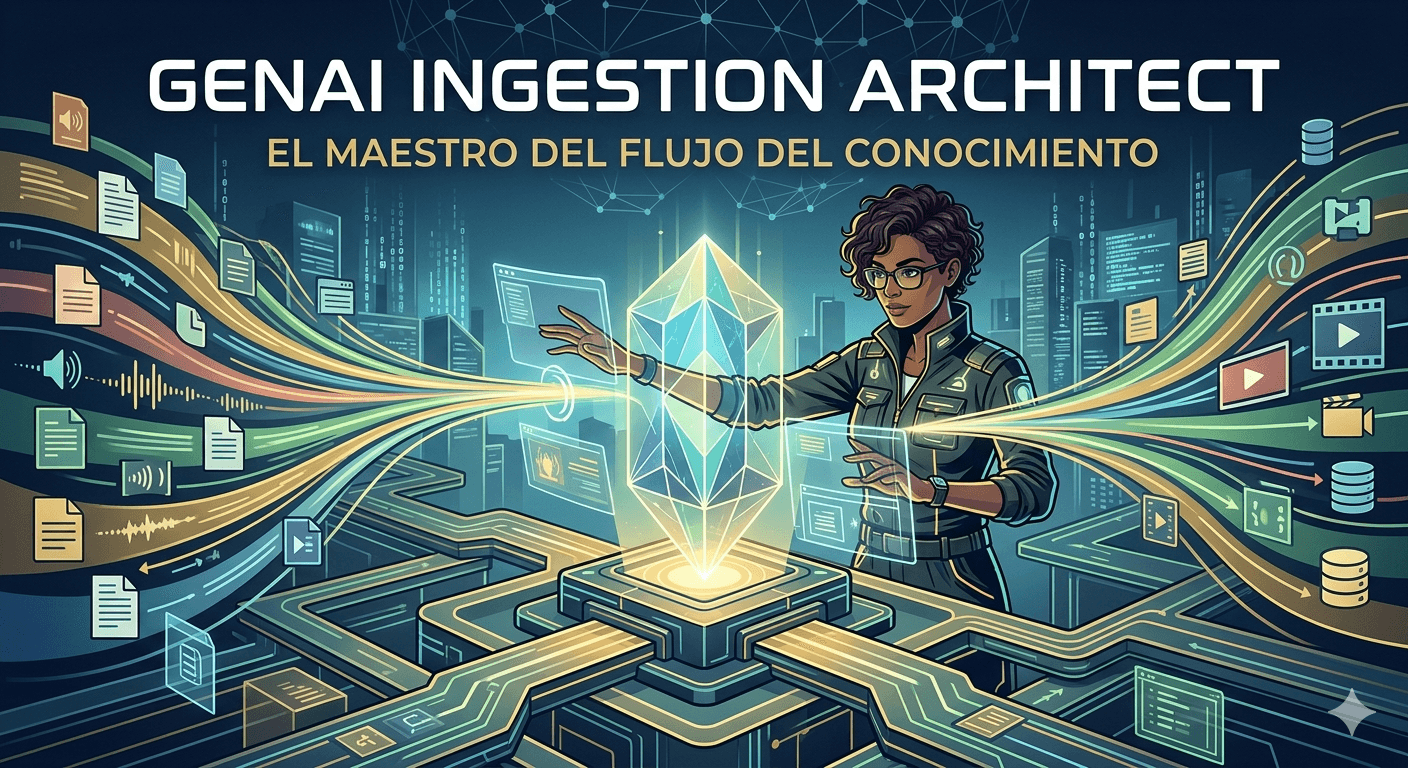

GenAI Ingestion Architect: El Maestro del Flujo del Conocimiento

En GenAI, la máxima "garbage in, garbage out" es más cierta que nunca. El GenAI Ingestion Architect es el profesional que diseña y controla los procesos de ingestión de información que alimentan a los agentes GenAI, asegurando calidad, versionado y disponibilidad del conocimiento.

El Desafío: Alimentar la Bestia

Los sistemas GenAI, especialmente aquellos basados en RAG (Retrieval-Augmented Generation), requieren acceso a información actualizada, relevante y de calidad. Pero esta información está dispersa:

Documentos: Confluence, SharePoint, Google Drive, PDFs

Bases de datos: PostgreSQL, MongoDB, Snowflake

Sistemas legacy: APIs antiguas, archivos planos, mainframes

Comunicaciones: Emails, Slack, Teams

Web: Sitios internos, documentación pública

Multimedia: Videos, imágenes, grabaciones de meetings

El problema: Cómo extraer, transformar y cargar todo esto de forma continua, confiable y auditable.

El Rol: Arquitecto de Pipelines Inteligentes

Un GenAI Ingestion Architect diseña la infraestructura que:

Extrae información de múltiples fuentes heterogéneas

Transforma datos crudos en formatos optimizados para GenAI

Valida calidad y completitud

Versioniza para trazabilidad

Indexa en vector databases y otros stores

Orquesta actualizaciones incrementales y full reloads

Monitoriza salud y performance de pipelines

Competencias Técnicas Core

1. Data Extraction Mastery

Conectores para Fuentes Estructuradas:

Databases:

SQL databases (PostgreSQL, MySQL, SQL Server)

NoSQL (MongoDB, Cassandra, DynamoDB)

Data warehouses (Snowflake, BigQuery, Redshift)

Estrategias: CDC (Change Data Capture), polling, triggers

# Ejemplo conceptual: CDC con Debezium

{

"connector": "debezium-postgres",

"database": "customer_db",

"tables": ["customers", "transactions"],

"mode": "incremental",

"output": "kafka_topic_customer_changes"

}

APIs:

REST APIs con paginación

GraphQL queries

gRPC services

Webhooks para push-based updates

Rate limiting y retry strategies

Conectores para Fuentes No Estructuradas:

Document Management Systems:

Confluence: API para spaces, pages, attachments

SharePoint: Microsoft Graph API

Google Drive: Drive API con change notifications

Notion: Official API

Dropbox: API + webhooks

Challenges:

Permisos complejos (quien puede ver qué)

Jerarquías y relationships (page parent-child)

Attachments y formatos variados

Rate limits

Communication Platforms:

Slack: Export APIs, threading, reactions

Microsoft Teams: Graph API, channels, chats

Email: IMAP/SMTP, attachments

Jira: Issues, comments, history

Web Scraping:

Intelligent crawling (respetando robots.txt)

JavaScript rendering (Playwright, Selenium)

Content extraction vs boilerplate

Change detection

2. Data Transformation Pipeline

Document Parsing:

PDFs:

# Challenge: PDFs pueden tener texto, imágenes, tablas, forms

Layers de parsing:

1. Text extraction (pdfplumber, PyPDF2)

2. Layout detection (detectar columnas, headers)

3. Table extraction (Camelot, Tabula)

4. Image extraction + OCR (Tesseract, Google Vision)

5. Merge everything coherentemente

HTML:

Limpieza de boilerplate (ads, menus, footers)

Extracción de main content

Preservation de estructura semántica (headings)

Handling de JavaScript-rendered content

Word/Excel/PowerPoint:

Preservación de formatting cuando relevante

Tablas → structured data

Comments y track changes

Metadata extraction (autor, fecha, versión)

Code:

Syntax highlighting preservation

Docstring extraction

Function/class boundaries

Comment extraction

Multimedia:

Images:

OCR para text en imágenes

Object detection y description (GPT-4V, CLIP)

Alt text generation

Metadata extraction (EXIF)

Audio/Video:

Transcription (Whisper, AssemblyAI)

Speaker diarization

Timestamp alignment con slides/docs

Key moment extraction

Text Normalization:

Pipeline ejemplo:

1. Encoding standardization (UTF-8)

2. Language detection

3. HTML entity decoding ( → space)

4. Unicode normalization (NFD vs NFC)

5. Whitespace normalization

6. Case folding (opcional, depende del use case)

7. Special character handling

3. Chunking Strategies

El arte de dividir documentos en chunks óptimos para RAG.

Estrategias:

1. Fixed Size:

chunk_size = 512 # tokens

overlap = 50 # tokens overlap entre chunks

# Simple, predecible, pero rompe contexto

2. Semantic Chunking:

# Dividir en boundaries naturales:

- Por párrafos

- Por secciones (detectando headings)

- Por oraciones completas

# Preserve context, pero chunks de tamaño variable

3. Recursive Chunking:

# LangChain RecursiveCharacterTextSplitter

Intentar dividir en este orden:

1. Por "\n\n" (párrafos)

2. Si chunk muy grande, por "\n" (líneas)

3. Si aún grande, por ". " (oraciones)

4. Si aún grande, por character limit

4. Document-Type-Specific:

Code: Por funciones/clases

Tablas: Mantener tabla completa (o por filas lógicas)

FAQs: Una Q&A por chunk

Legal docs: Por cláusulas/sections

Trade-offs:

Chunks pequeños: Retrieval más preciso, pero menos contexto

Chunks grandes: Más contexto, pero retrieval menos preciso

Overlap: Reduce pérdida de contexto en boundaries, pero duplica data

4. Metadata Enrichment

Metadata es crítico para filtering y ranking.

Metadata Esencial:

{

"doc_id": "uuid",

"source": "confluence",

"source_url": "https://...",

"title": "Política de Crédito 2026",

"author": "Juan Pérez",

"created_at": "2026-01-15",

"updated_at": "2026-03-20",

"version": "v3.2",

"department": "Risk Management",

"classification": "internal",

"tags": ["credit", "policy", "risk"],

"language": "es",

"chunk_index": 3,

"total_chunks": 15,

"file_type": "pdf"

}

Metadata Derivado:

Keywords: Extracted via TF-IDF o LLM

Summary: Generado con LLM

Entities: NER (people, orgs, dates, amounts)

Topics: Topic modeling

Sentiment: Si relevante

Quality score: Metadata completeness, readability

5. Embedding Generation

Model Selection:

| Model | Dimensiones | Use Case | Costo |

|---|---|---|---|

| OpenAI ada-002 | 1536 | General purpose | Medio |

| OpenAI text-embedding-3-large | 3072 | Alta calidad | Alto |

| Cohere embed-multilingual | 768 | Multi-idioma | Medio |

| Sentence-Transformers | 384-1024 | Local, privado | Gratis (GPU) |

Optimization:

# Batching para efficiency

batch_size = 100 # Documentos por llamada API

total_docs = 10000

for i in range(0, total_docs, batch_size):

batch = documents[i:i+batch_size]

embeddings = embedding_model.embed(batch)

vector_db.upsert(embeddings, metadata)

Caching:

# Cache embeddings por hash de contenido

content_hash = sha256(chunk_text)

if not cache.exists(content_hash):

embedding = model.embed(chunk_text)

cache.set(content_hash, embedding)

6. Incremental Updates & Change Detection

Strategies:

Full Reload (Naive):

Simple: borrar todo, recargar todo

Downside: Costoso, downtime, desperdicia recursos

Incremental (Smart):

1. Detectar qué cambió:

- APIs con "last_modified" filter

- Database CDC

- File system watchers

2. Identificar impacto:

- Documento nuevo → insert

- Documento modificado → update

- Documento borrado → delete

3. Actualizar solo lo necesario:

- Re-chunk solo docs modificados

- Re-embed solo nuevos chunks

- Update vector DB selectivamente

Versioning:

# Mantener versiones históricas

vector_db.upsert({

"id": "doc_123_v1",

"content": "...",

"version": 1,

"valid_from": "2026-01-01",

"valid_to": "2026-03-01"

})

# Query puede especificar "as of date"

results = vector_db.query(

query_vector,

filter={"valid_from": {"$lte": "2026-02-15"},

"valid_to": {"$gte": "2026-02-15"}}

)

7. Data Validation & Quality Gates

Pre-Ingestion Validation:

checks = [

"file_not_corrupted",

"file_size_within_limits",

"valid_encoding",

"content_not_empty",

"mime_type_supported"

]

Post-Transformation Validation:

checks = [

"chunks_not_empty",

"chunk_count_reasonable",

"metadata_complete",

"embeddings_generated",

"vector_dimensions_correct"

]

Quality Metrics:

Completeness: % de campos metadata populated

Freshness: Age of data vs update frequency esperada

Coverage: % de fuentes successfully ingested

Duplication rate: Detectar contenido duplicado

8. Orchestration & Scheduling

Orchestration Patterns:

Event-Driven:

# Webhooks desde source systems

POST /ingest/confluence/webhook

{

"event": "page_updated",

"space": "ENG",

"page_id": "123456"

}

# Trigger pipeline para ese documento específico

Scheduled:

# Cron-like scheduling

Schedule:

- Confluence: cada 1 hora

- SharePoint: cada 30 min

- Database: cada 5 min (CDC)

- File share: cada 24 horas

Hybrid:

Webhooks para updates inmediatos

Scheduled como safety net (catch missed webhooks)

Full reload semanal/mensual para drift correction

Tools:

Apache Airflow: DAGs complejos

Prefect: Modern, Python-native

Temporal: Durable workflows

AWS Step Functions / Azure Logic Apps: Cloud-native

9. Error Handling & Resilience

Failure Modes:

Source system down

Rate limit exceeded

Parsing failure (corrupted file)

Embedding API timeout

Vector DB unreachable

Strategies:

Retry with Exponential Backoff:

max_retries = 3

for attempt in range(max_retries):

try:

result = api_call()

break

except TransientError:

sleep(2 ** attempt)

Dead Letter Queue:

# Documents que fallan múltiples veces → DLQ

# Para análisis manual posterior

Graceful Degradation:

# Si embeddings API falla, queue document para retry

# Sistema sigue funcionando con knowledge existente

Circuit Breaker:

# Si source system tiene >50% error rate, pause ingestion

# Alert ops team, retry después de cooldown

10. Multi-Tenancy & Isolation

En entornos enterprise, diferentes tenants tienen diferentes data sources.

Patterns:

Namespace Isolation:

# Cada tenant tiene su namespace en vector DB

tenant_a_index = "vector_db_tenant_a"

tenant_b_index = "vector_db_tenant_b"

Metadata-Based Filtering:

# Shared index, filtering por tenant_id

vector_db.query(

query_vector,

filter={"tenant_id": "tenant_a"}

)

Per-Tenant Pipelines:

# Cada tenant tiene su propio ingestion pipeline

# Con sus propios schedules, sources, configs

Stack Tecnológico

Orchestration

Apache Airflow

Prefect

Dagster

Temporal

AWS Step Functions

Data Extraction

Airbyte: 300+ connectors out-of-the-box

Fivetran: Managed, enterprise

Custom Python: requests, aiohttp, SDKs

Document Processing

Unstructured.io: Universal document parser

Apache Tika: Metadata extraction

LangChain DocumentLoaders: Convenience wrappers

LlamaIndex DataConnectors: Similar

Change Data Capture

Debezium: CDC from databases

AWS DMS: Database migration + CDC

Maxwell: MySQL CDC

Vector Databases

- Pinecone, Weaviate, Qdrant (ya cubiertos)

Monitoring

Airflow UI / Prefect Cloud

Datadog para pipelines

Custom dashboards (Grafana)

Arquitectura de Referencia

┌──────────────────────────────────────────┐

│ Data Sources │

│ ┌──────┬──────┬──────┬────────┬──────┐ │

│ │Confl.│S.Point│Drive│Database│Slack │ │

│ └──┬───┴──┬───┴──┬───┴───┬────┴──┬───┘ │

└─────┼──────┼──────┼───────┼───────┼─────┘

│ │ │ │ │

▼ ▼ ▼ ▼ ▼

┌──────────────────────────────────────────┐

│ Extraction Layer (Airflow) │

│ ┌─────────────────────────────────────┐ │

│ │ Connectors / API Clients / CDC │ │

│ └─────────────────────────────────────┘ │

└──────────────┬───────────────────────────┘

▼

┌──────────────────────────────────────────┐

│ Transformation Layer │

│ ┌─────────────────────────────────────┐ │

│ │ Parsing → Chunking → Metadata │ │

│ └─────────────────────────────────────┘ │

└──────────────┬───────────────────────────┘

▼

┌──────────────────────────────────────────┐

│ Validation & Quality Gates │

│ ┌─────────────────────────────────────┐ │

│ │ Completeness / Format / Duplicates │ │

│ └─────────────────────────────────────┘ │

└──────────────┬───────────────────────────┘

▼

┌──────────────────────────────────────────┐

│ Embedding Generation │

│ ┌─────────────────────────────────────┐ │

│ │ OpenAI API / Cohere / Local Model │ │

│ └─────────────────────────────────────┘ │

└──────────────┬───────────────────────────┘

▼

┌──────────────────────────────────────────┐

│ Storage Layer │

│ ┌───────────┬──────────────┬─────────┐ │

│ │Vector DB │Metadata DB │Object │ │

│ │(Weaviate) │(PostgreSQL) │Storage │ │

│ └───────────┴──────────────┴─────────┘ │

└──────────────────────────────────────────┘

Casos de Uso en Banca

1. Knowledge Base Interna

Ingestar toda la documentación de políticas, procedimientos, regulaciones.

Sources:

Confluence (políticas)

SharePoint (procedimientos)

PDF repository (regulaciones)

Jira (tickets históricos con soluciones)

Challenges:

Docs en español e inglés

Actualizaciones frecuentes (cumplimiento)

Control de versiones estricto

Acceso diferenciado por roles

2. Customer Support RAG

Alimentar chatbot con información de productos/servicios.

Sources:

CRM (Salesforce) - info de productos

Zendesk - tickets resueltos (knowledge base)

Marketing materials

FAQ websites

Challenges:

Datos de múltiples sistemas

Info conflictiva entre fuentes (marketing vs técnico)

Freshness crítica (productos cambian)

Multi-idioma

3. Regulatory Compliance

Index de todas las regulaciones aplicables (Basel, SOX, locales).

Sources:

Regulatory websites (scraping cuidadoso)

Internal compliance docs

Legal database

Challenges:

Legal text es denso y complejo

Updates críticos (nueva regulación)

Versionado histórico (qué aplicaba cuándo)

Trazabilidad para auditorías

Métricas de Éxito

Pipeline Health:

Success rate: % de runs exitosos

Data freshness: Lag entre source update y indexed

Throughput: Documentos procesados por hora

Error rate: % de docs que fallan procesamiento

Data Quality:

Completeness: % docs con metadata completo

Duplication rate: % de chunks duplicados

Coverage: % de known sources successfully ingested

Embedding quality: Semantic coherence checks

Cost Efficiency:

Cost per document ingested

Embedding API costs

Compute costs (parsing, chunking)

Storage costs

Desafíos Únicos

El Problema de la Escala

Una empresa grande puede tener millones de documentos. Procesarlos initial vez puede tardar días/semanas.

El Dilema de Updates

Actualizar un documento puede invalidar múltiples chunks y sus embeddings. ¿Re-procesamos todo o solo lo modificado? ¿Cómo detectar qué cambió realmente?

Calidad Variable de Sources

Confluence puede tener docs antiguos, incorrectos, o mal formateados. ¿Cómo filtrar noise?

Dependencies entre Documents

Documentos referencian otros docs. ¿Cómo mantener esas relaciones post-chunking?

El Futuro del Rol

Agents que Mantienen su Propio Conocimiento: Agentes autónomos que detectan gaps en su conocimiento y trigger ingestion.

Real-Time Everything: Move de batch a streaming: eventos en source system → inmediatamente en vector DB.

Self-Healing Pipelines: ML que detecta anomalías en ingestion quality y auto-corrige.

Conclusión

El GenAI Ingestion Architect es el guardián de la calidad del conocimiento. En sistemas GenAI, especialmente RAG, el output nunca puede ser mejor que el input. Un mal pipeline de ingestion resulta en agentes que aluc inan, responden con información obsoleta, o simplemente no encuentran lo que necesitan.

En banca, donde precisión y compliance no son negociables, el rol de Ingestion Architect se vuelve misión crítica. No basta con "subir documentos" - necesitas pipelines robustos, auditables, versionados y monitoreados.

Data limpia, versionada y fresca = Agentes GenAI confiables.

¿Cómo gestionas la ingestion de datos para tus sistemas GenAI? ¿Qué desafíos has enfrentado?

#GenAI #DataEngineering #ETL #RAG #VectorDatabases #DataPipelines